ΔΕΙΤΕ ΠΡΩΤΟΙ ΟΛΑ ΤΑ ΝΕΑ ΤΟΥ TRIBUNE ΣΤΟ GOOGLE NEWS

ΔΕΙΤΕ ΠΡΩΤΟΙ ΟΛΑ ΤΑ ΝΕΑ ΤΟΥ TRIBUNE ΣΤΟ GOOGLE NEWS

Οι τουρκικές φυλλάδες «πανηγυρίζουν» για τη σχεδιαζόμενη αρπαγή ελληνικών θαλασσών από την πειρατική Τουρκία

Οι τουρκικές φυλλάδες «πανηγυρίζουν» για τη σχεδιαζόμενη αρπαγή ελληνικών θαλασσών από την πειρατική Τουρκία  UFO στην Ελλάδα: Τα έγγραφα του Πενταγώνου αποκαλύπτουν τρία περιστατικά στο Αιγαίο - Η δήλωση Τραμπ

UFO στην Ελλάδα: Τα έγγραφα του Πενταγώνου αποκαλύπτουν τρία περιστατικά στο Αιγαίο - Η δήλωση Τραμπ  Τέλος η Σία Κοσιώνη από τον ΣΚΑΪ

Τέλος η Σία Κοσιώνη από τον ΣΚΑΪ  Bloomberg: Η κυβέρνηση Ερντογάν ετοιμάζεται για διεκδίκηση θαλάσσιας δικαιοδοσίας σε περιοχές του Αιγαίου και της Μεσογείου

Bloomberg: Η κυβέρνηση Ερντογάν ετοιμάζεται για διεκδίκηση θαλάσσιας δικαιοδοσίας σε περιοχές του Αιγαίου και της Μεσογείου  Ρωσικό στόχο στο Ιόνιο επρόκειτο να πλήξει το Ουκρανικό στρατιωτικό drone «φορτωμένο» με 300 κιλά εκρηκτικών υλών;

Ρωσικό στόχο στο Ιόνιο επρόκειτο να πλήξει το Ουκρανικό στρατιωτικό drone «φορτωμένο» με 300 κιλά εκρηκτικών υλών;

ΔΕΙΤΕ ΠΡΩΤΟΙ ΟΛΑ ΤΑ ΝΕΑ ΤΟΥ TRIBUNE ΣΤΟ GOOGLE NEWS

ΔΕΙΤΕ ΠΡΩΤΟΙ ΟΛΑ ΤΑ ΝΕΑ ΤΟΥ TRIBUNE ΣΤΟ GOOGLE NEWS

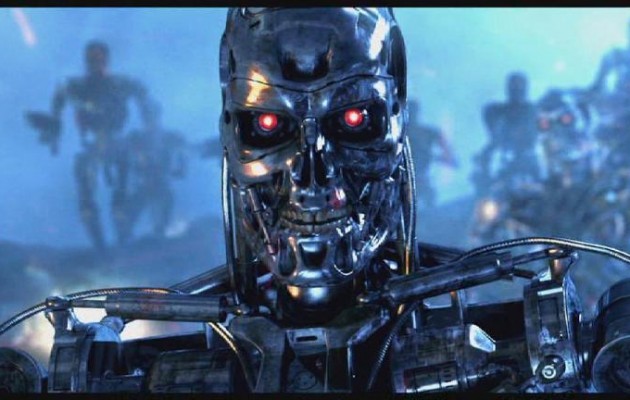

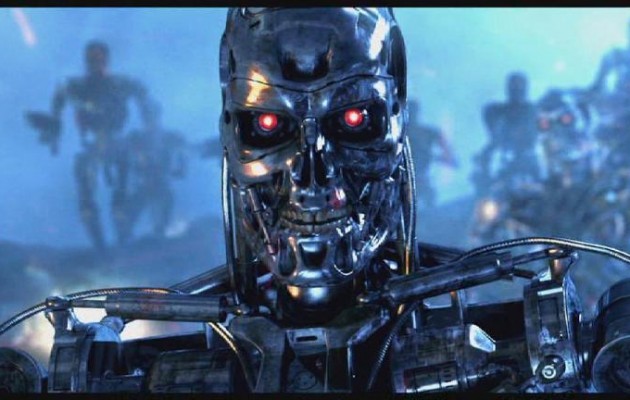

Ο κορυφαίος αστροφυσικός Στίβεν Χόκινγκ προειδοποίησε ότι οι προσπάθειες της ανθρωπότητας να δημιουργήσει υπολογιστές και ρομπότ με εξελιγμένη τεχνητή νοημοσύνη, μπορούν να αποτελέσουν σοβαρή απειλή για το ανθρώπινο είδος, οδηγώντας δυνητικά ακόμη και στον αφανισμό του!

Και μπορεί να μην είναι η πρώτη φορά που εκφράζεται μια τέτοια άποψη, όμως όταν αυτή η προειδοποίηση προέρχεται από τον Χόκινγκ έχει ιδιαίτερη βαρύτητα.

«Η πλήρης ανάπτυξη της τεχνητής νοημοσύνης μπορεί να σημάνει το τέλος του ανθρώπινου είδους», δήλωσε ο κορυφαίος επιστήμονας στο BBC.

Όπως ανέφερε, οι απλοϊκές μορφές τεχνητής νοημοσύνης που έχουν δημιουργηθεί μέχρι στιγμής, έχουν αποδειχτεί πολύ χρήσιμες, όμως εξέφρασε τον φόβο του για τις συνέπειες που μπορεί να υπάρξουν, αν η τεχνητή νοημοσύνη δημιουργήσει κάτι που θα ξεπεράσει τις ανθρώπινες ικανότητες.

«Θα έκανε κουμάντο μόνο του και θα επανασχεδίαζε τον εαυτό του με ολοένα αυξανόμενη ταχύτητα. Οι άνθρωποι, που είναι περιορισμένοι από την αργή βιολογική εξέλιξη, δεν θα μπορούσαν να το ανταγωνιστούν και θα έμεναν πίσω», τόνισε χαρακτηριστικά.

Ειδικοί και μη, εμφανίζονται διχασμένοι πάνω στο ζήτημα αυτό. Αρκετοί είναι πιο αισιόδοξοι και λιγότερο επιφυλακτικοί, όμως άλλοι συμμερίζονται τις ανησυχίες του Χόκινγκ, όπως ο Έλον Μασκ, δημιουργός της ιδιωτικής διαστημικής εταιρείας Spaxe X, ο οποίος προ ημερών, στο ίδιο ακριβώς μήκος κύματος, προειδοποίησε, ότι «η τεχνητή νοημοσύνη συνιστά τη μεγαλύτερη υπαρξιακή απειλή για την ανθρωπότητα».